I imam problem sa robots.txt fajlom, koji mi nije bas logican

struktura foldera mi je ovakva otprilike

ftp_root/domain/htdocs/....

u domain folderu imam jedan robots.txt

/domain/robots.txt

User-agent: *

Allow: /

Kapiram da to treba da zabrani svim robotima da svrljaju po sajtu, ali mi nije jasno zasto se nalazi u tom folderu.

Posle toga imam jos jedan robots.txt u htdocs

ftp_root/domain/htdocs/robots.txt i u njemu sam imao samo

User-agent: *

Disallow: /

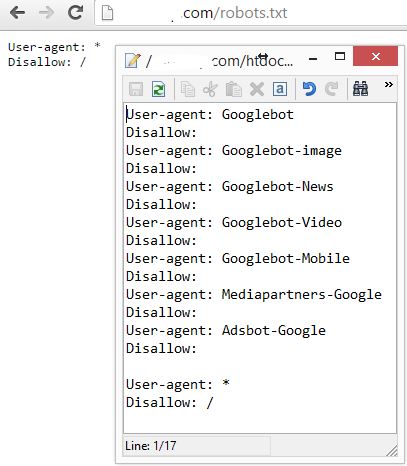

Pa sam dodao sledece i sad je ovako

User-agent: Googlebot

Disallow:

User-agent: Googlebot-image

Disallow:

User-agent: *

Disallow: /

Kako kapiram, ovo bi trebalo da zabrani sve robote osim Googlebot i Googlebot-image?

problem je sto sad kad odem na

http://domain.com/robots.txt

Tu mi i dalje po starom pise samo

User-agent: *

Disallow: /

gde gresim?

Da li onaj prvi robots.txt u folderu ispred moze da mi pravi problem?

Mada je unjemu sve allow

robot.txt, ne vidim izmene

robot.txt, ne vidim izmene